Czego dowiesz się z tej strony?

Pipe SSE dla Open WebUI – most pomiędzy interfejsem a agentem LangGraph

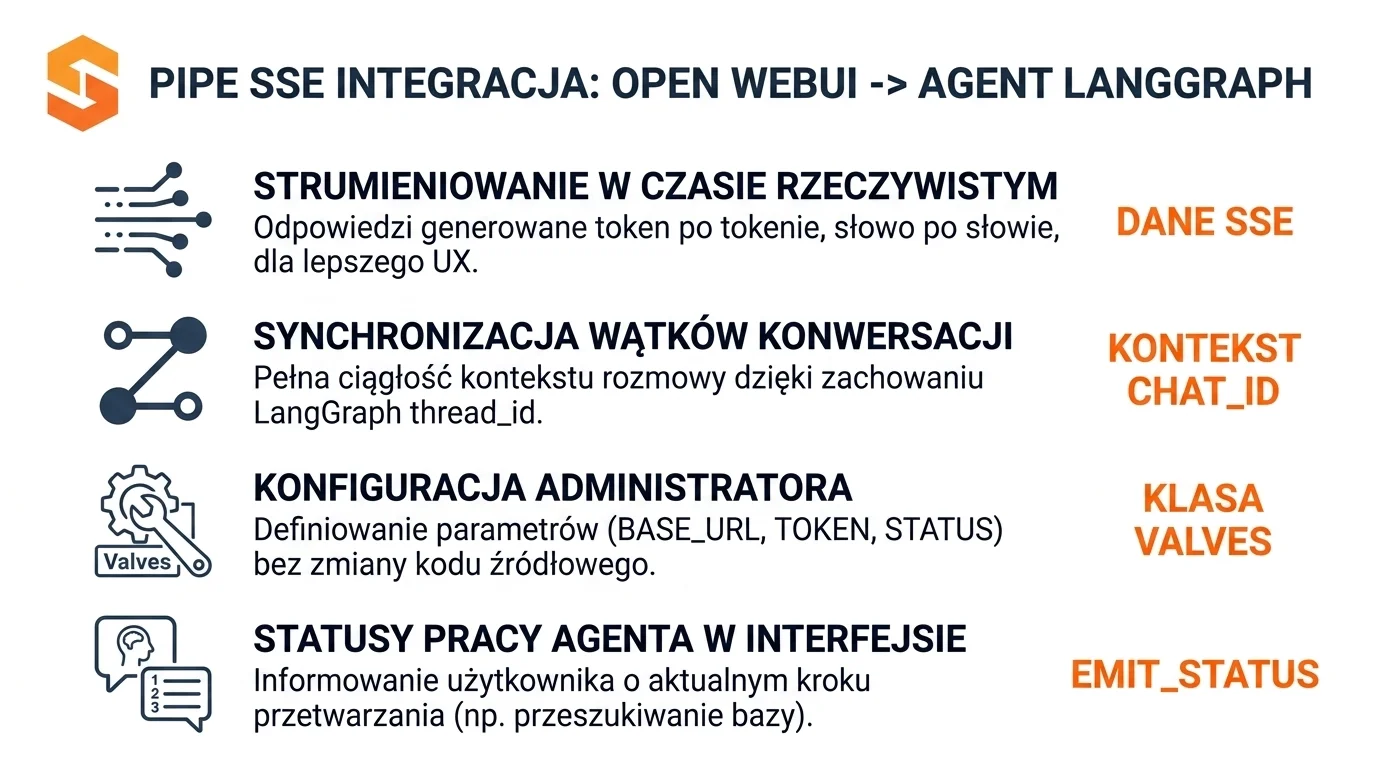

Pipe SSE to komponent integracyjny działający jako proxy pomiędzy platformą Open WebUI a agentem konwersacyjnym zbudowanym w LangGraph. Rozwiązanie umożliwia strumieniowanie odpowiedzi w czasie rzeczywistym oraz zachowanie ciągłości kontekstu rozmowy dzięki synchronizacji wątków przez thread_id.

- Strumieniowanie SSE (Server-Sent Events). Odpowiedź agenta jest przesyłana słowo po słowie natychmiast po wygenerowaniu każdego tokenu, eliminując oczekiwanie na kompletny wynik i poprawiając odbiór UX.

- Synchronizacja wątków konwersacji. Mechanizm ekstrakcji

chat_idz domknięć Pythona pozwala przypisać każde zapytanie do właściwego wątku w bazie LangGraph, zapewniając agentowi pamięć kontekstu rozmowy. - Konfiguracja przez klasę Valves. Administrator definiuje adres backendu (

BASE_URL), token autoryzacji (BEARER_TOKEN) oraz włącza lub wyłącza dymki statusu (STATUS_ENABLED) bez ingerencji w kod źródłowy. - Statusy pracy agenta w interfejsie. Funkcja

emit_statuskontroluje częstotliwość i treść komunikatów wyświetlanych użytkownikowi (np. „Przeszukuję bazę wiedzy”), informując o aktualnym kroku przetwarzania. - Buforowanie i parsowanie zdarzeń SSE. Dane napływają w nieregularnych chunkach; kod zbiera je w buforze i rozdziela zdarzenia po znaku

\n\n, rozróżniając typy:token,statusidata: [DONE]. - Asynchroniczne żądania HTTP przez aiohttp. Biblioteka

aiohttpobsługuje połączenia nieblokująco, umożliwiając równoległą obsługę wielu strumieni bez degradacji wydajności serwera Open WebUI. - Punkt wejścia pipe i zapis wiadomości. Metoda

pipepobiera ostatnie zapytanie użytkownika, uruchamia strumień i po jego zakończeniu zwraca pełną odpowiedź do zapisania w bazie danych Open WebUI jako kompletna wiadomość asystenta. - Komunikat chat:message:delta. Specjalny typ zdarzenia wysyłany do UI nakazuje dołączanie kolejnych fragmentów tekstu do aktualnie renderowanej wiadomości, tworząc efekt płynnego pisania.

Pipe (Open WebUI)

Pipe to wtyczka integracyjna platformy Open WebUI pełniąca rolę pośrednika (proxy) między interfejsem użytkownika a zewnętrznym backendem AI. Komponent przechwytuje wiadomości użytkownika, przesyła je do zdefiniowanego API i zarządza powrotem odpowiedzi do UI. Architektura pipe pozwala podpiąć dowolny serwis zewnętrzny – w tym agenty LangGraph – bez modyfikowania rdzenia platformy. Dzięki temu podejściu organizacje mogą budować własne agenty i udostępniać je przez ujednolicony interfejs czatu.

SSE – Server-Sent Events

Server-Sent Events to protokół komunikacji jednostronnej oparty na HTTP, w którym serwer wysyła zdarzenia do klienta w sposób ciągły bez potrzeby ponownego nawiązywania połączenia. W kontekście systemów AI każdy wygenerowany token (fragment odpowiedzi) jest natychmiast przesyłany jako osobne zdarzenie, tworząc efekt płynnego pisania widoczny dla użytkownika. Zdarzenia są tekstowe, rozdzielone sekwencją \n\n, i mogą zawierać różne typy danych – tokeny, statusy lub sygnał zakończenia. SSE stanowi lżejszą alternatywę dla WebSocketów przy strumieniowaniu odpowiedzi w jednym kierunku (serwer do klienta).

LangGraph

LangGraph to biblioteka Pythona służąca do budowania agentów konwersacyjnych i wieloetapowych przepływów pracy AI w postaci grafów skierowanych (directed graphs). Każdy węzeł grafu reprezentuje krok logiczny – wywołanie modelu językowego, przeszukiwanie bazy wiedzy lub wykonanie narzędzia. Biblioteka umożliwia zarządzanie stanem rozmowy (thread_id), dzięki czemu agent „pamięta” historię konkretnego wątku i może prowadzić spójną, wieloturową konwersację. LangGraph jest często deployowany jako usługa FastAPI i komunikuje się z klientami poprzez endpointy REST lub SSE.

Thread_id – identyfikator wątku konwersacji

Thread_id to unikalny identyfikator przypisywany każdej sesji rozmowy w systemach agentowych, takich jak LangGraph. Dzięki niemu backend rozpoznaje, które zapytanie należy do którego wątku i może odtworzyć pełen kontekst historii czatu przy każdym kolejnym pytaniu. W opisywanym rozwiązaniu thread_id jest pozyskiwany bezpośrednio z wewnętrznego chat_id platformy Open WebUI przy użyciu introspekcji domknięć Pythona. Synchronizacja obu identyfikatorów gwarantuje spójność stanu rozmowy między interfejsem a agentem.

Valves – konfiguracja pipe’a

Klasa Valves („zawory”) to mechanizm konfiguracyjny wtyczek Open WebUI umożliwiający administratorom zmianę parametrów działania pipe’a bez modyfikowania kodu źródłowego. Typowe parametry to adres serwera backendu (BASE_URL), klucz autoryzacji (BEARER_TOKEN) oraz przełączniki funkcjonalne, takie jak włączenie statusów (STATUS_ENABLED). Wartości konfigurowane przez Valves są widoczne i edytowalne bezpośrednio w panelu administracyjnym Open WebUI. Podejście to zwiększa bezpieczeństwo wdrożeń – poufne dane uwierzytelniające nie są przechowywane w repozytorium kodu.

Pipe SSE dla Open WebUI i LangGraph

Poniższa tabela przedstawia funkcjonalności komponentu Pipe SSE zestawione z realnym wpływem każdej z nich na działanie systemu i doświadczenie użytkownika. Dzięki temu zestawieniu programiści i administratorzy systemu szybko ocenią, które mechanizmy są niezbędne do wdrożenia agenta konwersacyjnego w środowisku produkcyjnym.

| Funkcjonalność | Mechanizm techniczny | Wpływ na system | Korzyść dla użytkownika |

|---|---|---|---|

| Strumieniowanie SSE | Server-Sent Events, token po tokenie | Eliminacja oczekiwania na pełną odpowiedź | Natychmiastowy odbiór tekstu, lepszy UX |

| Synchronizacja wątków konwersacji | Ekstrakcja chat_id przez domknięcia Pythona | Przypisanie zapytania do właściwego wątku w LangGraph | Agent pamięta kontekst rozmowy |

| Konfiguracja przez klasę Valves | BASE_URL, BEARER_TOKEN, STATUS_ENABLED | Zmiana parametrów bez modyfikacji kodu źródłowego | Łatwe zarządzanie środowiskiem przez administratora |

| Statusy pracy agenta | Funkcja emit_status z kontrolą częstotliwości | Wyświetlanie komunikatów o bieżącym kroku przetwarzania | Użytkownik wie, co agent aktualnie wykonuje |

| Buforowanie i parsowanie zdarzeń SSE | Rozdzielanie chunków po \n\n, typy: token, status, [DONE] | Poprawna obsługa nieregularnego napływu danych | Stabilny strumień bez utraty fragmentów odpowiedzi |

| Asynchroniczne żądania HTTP | Biblioteka aiohttp, połączenia nieblokujące | Równoległa obsługa wielu strumieni | Brak degradacji wydajności przy wysokim obciążeniu |

| Punkt wejścia pipe i zapis wiadomości | Metoda pipe, zapis pełnej odpowiedzi do bazy Open WebUI | Kompletna wiadomość asystenta dostępna po zakończeniu strumienia | Historia rozmów zachowana w interfejsie |

| Zdarzenie chat:message:delta | Specjalny typ zdarzenia wysyłany do UI | Dołączanie fragmentów tekstu do renderowanej wiadomości | Efekt płynnego pisania w czasie rzeczywistym |

Zastosowanie w projektach deweloperskich

- Budowa asystenta wewnętrznego opartego na LangGraph z interfejsem Open WebUI bez pisania własnego frontendu.

- Testowanie różnych agentów LangGraph przez zmianę

BASE_URLw Valves bez modyfikacji kodu pipe. - Wdrożenie wielu instancji agenta dla różnych zespołów z osobnymi tokenami autoryzacji.

Zastosowanie w środowiskach produkcyjnych

- Obsługa równoległych sesji użytkowników dzięki asynchronicznej bibliotece

aiohttpbez ryzyka przeciążenia serwera. - Monitorowanie postępu długich operacji agenta przez statusy wyświetlane bezpośrednio w oknie czatu.

- Zachowanie historii rozmów w bazie Open WebUI umożliwia audyt i analizę zapytań użytkowników.

Zastosowanie przy integracji z bazami wiedzy

- Synchronizacja wątków przez

thread_idpozwala agentowi korzystać z kontekstu poprzednich zapytań przy przeszukiwaniu bazy wiedzy. - Komunikaty statusu informują użytkownika o postępie wyszukiwania, np. „Przeszukuję bazę wiedzy”, zanim pojawi się odpowiedź.

- Strumieniowanie tokenów skraca subiektywny czas oczekiwania nawet przy rozbudowanych zapytaniach RAG.

Zastosowanie w konfiguracji i utrzymaniu systemu

- Administrator włącza lub wyłącza dymki statusu przez

STATUS_ENABLEDbez dostępu do kodu źródłowego. - Zmiana adresu backendu w jednym polu Valves umożliwia przełączenie między środowiskiem testowym a produkcyjnym.

- Parsowanie buforowane zabezpiecza system przed błędami przy nieregularnym napływie danych z agenta.

Budowa własnego agenta konwersacyjnego nie musi oznaczać miesięcy pracy nad frontendem. Pipe SSE to gotowy komponent integracyjny, który łączy platformę Open WebUI z agentem LangGraph i dostarcza strumieniowanie odpowiedzi token po tokenie – bez jednej linii kodu po stronie interfejsu użytkownika.

Rozwiązanie eliminuje trzy typowe problemy wdrożeniowe: brak płynności odpowiedzi, utratę kontekstu między sesjami oraz żmudną konfigurację backendu przy każdej zmianie środowiska. Pipe SSE radzi sobie z nimi przez architekturę proxy opartą na Server-Sent Events, mechanizm synchronizacji wątków i klasę Valves dostępną z poziomu panelu administratora. Dowiedz się, jak ekosystem asystentów AI dla logistyki może zyskać na tej integracji.

Jak działa Pipe SSE jako komponent proxy Open WebUI

Pipe SSE to wtyczka integracyjna platformy Open WebUI działająca jako warstwa pośrednicząca między interfejsem użytkownika a zewnętrznym agentem konwersacyjnym zbudowanym w LangGraph. Komponent przechwytuje każde zapytanie użytkownika, przesyła je do skonfigurowanego backendu przez protokół SSE i zarządza powrotem odpowiedzi do okna czatu – słowo po słowie, w czasie rzeczywistym.

W odróżnieniu od klasycznego żądania HTTP – gdzie klient czeka na kompletną odpowiedź serwera – Server-Sent Events tworzą jednokierunkowy kanał strumieniowy. Każdy wygenerowany token jest natychmiast wysyłany jako osobne zdarzenie, rozdzielone sekwencją \n\n. Dla użytkownika przekłada się to na efekt płynnego pisania, który zmniejsza subiektywne odczucie czasu oczekiwania nawet przy rozbudowanych zapytaniach do bazy wiedzy. Więcej o możliwościach wdrożenia sztucznej inteligencji w przedsiębiorstwie znajdziesz na naszej stronie poświęconej tematyce AI.

Synchronizacja wątków przez thread_id

Jednym z najtrudniejszych problemów przy wdrożeniu agenta konwersacyjnego jest zachowanie ciągłości kontekstu między kolejnymi pytaniami. Pipe SSE rozwiązuje to przez mechanizm ekstrakcji chat_id z domknięć Pythona – wewnętrznego identyfikatora sesji Open WebUI – i przypisania go jako thread_id do właściwego wątku w bazie LangGraph. Dzięki temu agent nie zaczyna każdej odpowiedzi „od zera”, lecz pamięta historię całej rozmowy.

Synchronizacja obu identyfikatorów działa transparentnie i nie wymaga żadnej akcji ze strony użytkownika ani administratora. Każde nowe zapytanie w tym samym oknie czatu trafia automatycznie do właściwego wątku w backendzie, co gwarantuje spójność stanu niezależnie od liczby równoległych sesji.

Konfiguracja Valves i zarządzanie środowiskiem bez modyfikacji kodu

Klasa Valves to mechanizm konfiguracyjny wtyczek Open WebUI, który udostępnia parametry działania bezpośrednio w panelu administracyjnym – bez potrzeby edytowania kodu źródłowego. Administrator definiuje trzy podstawowe wartości: BASE_URL (adres serwera agenta), BEARER_TOKEN (klucz autoryzacji) oraz STATUS_ENABLED (przełącznik widoczności dymków statusu).

Podejście to przynosi wymierne korzyści operacyjne. Przełączenie między środowiskiem testowym a produkcyjnym sprowadza się do zmiany jednego pola w interfejsie, bez dostępu do repozytorium kodu. Poufne dane uwierzytelniające nie są przechowywane w kodzie źródłowym, co podnosi poziom bezpieczeństwa całego wdrożenia. Porównaj to z możliwościami monitorowania projektów IT w czasie rzeczywistym przez DeployMate AI, gdzie podobna filozofia konfigurowalności skraca czas reakcji na zmiany projektowe.

Statusy pracy agenta w interfejsie użytkownika

Funkcja emit_status kontroluje komunikaty wyświetlane użytkownikowi podczas przetwarzania zapytania – na przykład „Przeszukuję bazę wiedzy” lub „Analizuję dokumenty”. Administrator włącza lub wyłącza dymki statusu przez parametr STATUS_ENABLED w klasie Valves. Statusy informują o aktualnym kroku pracy agenta LangGraph i poprawiają transparentność całego procesu.

Widoczność postępu przetwarzania ma szczególne znaczenie przy zapytaniach do rozbudowanych baz wiedzy lub przy wieloetapowych przepływach RAG, gdzie czas odpowiedzi może być dłuższy. Użytkownik wie, że system pracuje, a nie zawiesił się – co bezpośrednio przekłada się na jakość odczucia z użytkowania aplikacji.

Buforowanie SSE i asynchroniczne żądania HTTP przez aiohttp

Dane ze strumienia SSE napływają w nieregularnych fragmentach zwanych chunkami. Kod Pipe SSE zbiera je w buforze i rozdziela zdarzenia po sekwencji \n\n, identyfikując trzy typy: token (fragment tekstu odpowiedzi), status (komunikat o bieżącym kroku agenta) oraz data: [DONE] (sygnał zakończenia strumienia). Takie buforowanie gwarantuje kompletność każdego zdarzenia przed jego przetworzeniem i zabezpiecza przed utratą fragmentów odpowiedzi przy wolniejszych połączeniach.

Biblioteka aiohttp obsługuje żądania HTTP asynchronicznie i nieblokująco, co jest wymagane przy równoległej obsłudze wielu strumieni SSE. Serwer Open WebUI może jednocześnie obsługiwać dziesiątki sesji użytkowników bez degradacji wydajności – synchroniczne biblioteki, takie jak requests, blokowałyby wątek i uniemożliwiały skalowanie. Dla firm planujących własny asystent AI pod pełną kontrolą firmy Pipe SSE stanowi gotowy element architektury, który daje się uruchomić w prywatnym środowisku on-premise lub chmurze.

Zdarzenie chat:message:delta i zapis kompletnej wiadomości

Specjalny typ zdarzenia SSE o nazwie chat:message:delta nakazuje interfejsowi Open WebUI dołączanie kolejnych fragmentów tekstu do aktualnie renderowanej wiadomości. To właśnie ten mechanizm tworzy charakterystyczny efekt płynnego pisania widoczny w nowoczesnych chatbotach – każdy nowy token pojawia się natychmiast bez odświeżania całego okna.

Po odebraniu zdarzenia [DONE] metoda pipe zwraca skompletowaną, pełną odpowiedź agenta do zapisania w bazie danych Open WebUI. Mechanizm łączy więc płynność doświadczenia użytkownika ze spójnością zapisu danych – historia rozmów jest dostępna do późniejszego audytu i analizy. Całość integracji działa w ramach jednego komponentu, bez dodatkowych serwisów pośredniczących.

Zastosowania Pipe SSE w środowiskach produkcyjnych i deweloperskich

Pipe SSE sprawdza się w trzech głównych scenariuszach. Pierwszy to wdrożenie asystenta wewnętrznego opartego na LangGraph z interfejsem Open WebUI – firma zyskuje gotowy, ujednolicony interfejs czatu bez budowania własnego frontendu. Drugi scenariusz to środowisko produkcyjne z wieloma równoległymi sesjami, gdzie asynchroniczna obsługa aiohttp gwarantuje stabilność nawet przy wysokim obciążeniu serwera. Trzeci to integracja z bazami wiedzy (RAG), gdzie synchronizacja wątków przez thread_id i widoczne statusy agenta znacznie poprawiają odczucie responsywności.

Rozwiązanie integruje się z prywatnym Chat GPT z bezpieczną infrastrukturą Azure, co pozwala organizacjom zachować pełną kontrolę nad danymi przy jednoczesnym korzystaniu z zaawansowanych możliwości modeli językowych. Firmy, które chcą zunifikować asystentów AI w jednym środowisku, znajdą w Pipe SSE elastyczny punkt wejścia – konfigurowalny przez Valves, skalowalny przez aiohttp i gotowy do integracji z dowolnym backendem LangGraph. Aby dowiedzieć się, jak asystenci AI zintegrowane z systemami WMS i CRM usprawniają codzienną pracę, zapraszamy do kontaktu z naszym zespołem – wspólnie dobierzemy architekturę, która odpowiada na rzeczywiste potrzeby Twojego przedsiębiorstwa.

Najczęściej zadawane pytania o Pipe SSE i Open WebUI

Czym jest Pipe SSE dla Open WebUI?

Pipe SSE to komponent integracyjny działający jako proxy między platformą Open WebUI a agentem konwersacyjnym zbudowanym w LangGraph. Umożliwia strumieniowanie odpowiedzi w czasie rzeczywistym – każdy token jest przesyłany natychmiast po wygenerowaniu. Dzięki temu użytkownik widzi tekst pojawiający się słowo po słowie, co znacząco poprawia odbiór interfejsu.

Jak SSE różni się od zwykłego żądania HTTP?

W klasycznym żądaniu HTTP klient czeka na kompletną odpowiedź serwera. SSE (Server-Sent Events) to jednokierunkowy kanał, przez który serwer przesyła dane w strumieniu natychmiast po ich wygenerowaniu. W kontekście agentów LLM eliminuje to oczekiwanie na pełną odpowiedź i tworzy efekt płynnego pisania w interfejsie użytkownika.

Co to jest thread_id w kontekście LangGraph?

Thread_id to unikalny identyfikator wątku konwersacji, który synchronizuje zapytania użytkownika z pamięcią agenta LangGraph. Pipe SSE ekstrahuje chat_id z domknięć Pythona i przypisuje go do właściwego wątku w bazie LangGraph. Dzięki temu agent pamięta kontekst całej rozmowy, a nie tylko ostatniego zapytania.

Jak skonfigurować Pipe SSE bez edycji kodu?

Konfiguracja odbywa się przez klasę Valves, która udostępnia parametry dostępne z poziomu panelu administracyjnego Open WebUI. Administrator definiuje adres backendu (BASE_URL), token autoryzacji (BEARER_TOKEN) oraz włącza lub wyłącza dymki statusu (STATUS_ENABLED). Żadna zmiana nie wymaga ingerencji w kod źródłowy komponentu.

Dlaczego Pipe SSE używa biblioteki aiohttp?

Biblioteka aiohttp obsługuje połączenia HTTP asynchronicznie i nieblokująco, co jest niezbędne przy równoległej obsłudze wielu strumieni SSE. Dzięki temu serwer Open WebUI może jednocześnie obsługiwać wielu użytkowników bez degradacji wydajności. Synchroniczne biblioteki jak requests blokowałyby wątek i uniemożliwiały skalowanie.

Jak działają statusy agenta w interfejsie użytkownika?

Funkcja emit_status kontroluje komunikaty wyświetlane użytkownikowi podczas przetwarzania zapytania, np. „Przeszukuję bazę wiedzy”. Administrator może włączyć lub wyłączyć dymki statusu przez parametr STATUS_ENABLED w klasie Valves. Statusy informują o aktualnym kroku pracy agenta LangGraph, poprawiając transparentność i UX aplikacji.

Jak Pipe SSE parsuje dane ze strumienia SSE?

Dane ze strumienia napływają w nieregularnych chunkach, dlatego kod zbiera je w buforze i rozdziela zdarzenia po sekwencji \n\n. Komponent rozróżnia trzy typy zdarzeń: token (fragment tekstu), status (komunikat o stanie agenta) oraz data: [DONE] (sygnał zakończenia strumienia). Takie podejście gwarantuje kompletność każdego zdarzenia przed jego przetworzeniem.

Co to jest zdarzenie chat:message:delta?

Chat:message:delta to specjalny typ zdarzenia SSE wysyłany do interfejsu Open WebUI, który nakazuje dołączanie kolejnych fragmentów tekstu do aktualnie renderowanej wiadomości. Dzięki temu każdy nowy token jest natychmiast dołączany do widocznej odpowiedzi, tworząc efekt płynnego pisania. Jest to mechanizm odpowiedzialny za charakterystyczną animację „streamowania” tekstu w chatbotach.

Gdzie Pipe SSE zapisuje pełną odpowiedź agenta?

Metoda pipe pobiera ostatnie zapytanie użytkownika, uruchamia strumień SSE i przez cały czas jego trwania wyświetla fragmenty tekstu w interfejsie. Po zakończeniu strumienia (zdarzenie [DONE]) metoda zwraca skompletowaną, pełną odpowiedź do zapisania w bazie danych Open WebUI jako kompletna wiadomość asystenta. Mechanizm łączy więc strumieniowanie UX z integralnością zapisu danych.